SOCIEDAD

Mapa de cortes en la Ciudad el 1° de marzo: estas son las calles en las que no se podrá transitar

El presidente Javier Milei encabeza este domingo 1 de marzo el acto de inicio del año legislativo en el Congreso de la Nación. El Poder Ejecutivo oficializó el horario de la ceremonia a las 21 horas. Casa Militar se encarga del esquema de seguridad para blindar la zona. Esta medida facilita el traslado de los funcionarios y previene incidentes en las inmediaciones del edificio durante la apertura de sesiones.

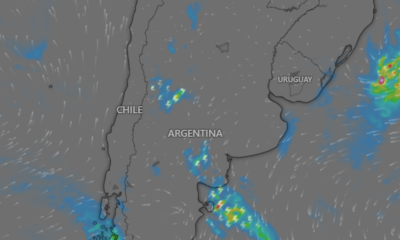

El mapa de los cortes de calle en CABA por la apertura de sesiones 2026

Aunque Casa Militar decidió todavía no publicar el cronograma oficial de la jornada, se espera un despliegue similar a los operativos que suelen aplicarse para este tipo de eventos en el Congreso:

El esquema preventivo contemplaría interrupciones totales en el cuadrante de las calles Ayacucho, Sarandí, Bartolomé Mitre, Solís y Adolfo Alsina. El tránsito vehicular sufre cortes absolutos en la Avenida Rivadavia, la calle Hipólito Yrigoyen y la intersección de la Avenida Entre Ríos con la Avenida Callao.

Este supuesto mapa de accesos estipula puntos específicos para el ingreso y egreso de personas autorizadas al recinto. Existe una salida peatonal para el personal sobre la calle Sarandí, entre Hipólito Yrigoyen y Adolfo Alsina. El acceso de cocheras y personal administrativo ocurre en la intersección de Bartolomé Mitre y Riobamba.

Estas restricciones comenzarían de forma estricta desde la tarde de este domingo 1° de marzo. El despliegue de seguridad garantiza el traslado de la comitiva oficial por el eje de la Avenida de Mayo. Las autoridades de transporte de la Ciudad priorizan el funcionamiento del Metrobús para minimizar las demoras en el centro porteño.

Los cierres totales afectarían también a la Avenida de Mayo y la Avenida Rivadavia desde la calle Lima hasta el Palacio Legislativo. El esquema preventivo busca evitar concentraciones espontáneas en los puntos de acceso directo a la Cámara de Diputados. El dispositivo policial termina una vez que el mandatario abandone el edificio legislativo tras su discurso.

Cómo ver la apertura de sesiones ordinarias

Para quienes quieran ver la apertura de sesiones ordinarias por streaming, el canal de YouTube de la Cámara de Diputados transmitirá el evento en vivo. También se podrá seguir minuto a minuto por LN+ en los siguientes canales según el cableoperador: en DirectTV (715 y 1715), Cablevisión (19 Clásico y Digital, HD y Flow), TeleCentro (1 y 705 Digital) y Movistar TV (101).

Por qué habla Javier Milei en el Congreso

Las sesiones ordinarias, que se extienden hasta el 30 de noviembre, son inauguradas por el Presidente el 1° de marzo de cada año. Este es un acto institucional que se repite cada año como una manera de dar comienzo formal a la actividad parlamentaria.

Durante la jornada de inauguración el jefe de Estado es uno de los protagonistas, dado que la Constitución lo asigna como el encargado de brindar un discurso en el que se perfile la agenda legislativa para el año que se inaugura.

Como indica la Carta Magna en el artículo 63 de las disposiciones comunes a ambas cámaras, los diputados y senadores se reúnen por sí mismos—es decir, en forma separada según la cámara a la que correspondan— en “sesiones ordinarias todos los años desde el 1° de marzo hasta el 30 de noviembre”.

Este contenido fue producido por un equipo de LA NACION con la asistencia de la IA.

paro de controladores aéreos en aeroparque. 94 vuelos y 11.000 pasajeros afectados,paro de controladores aéreos,sociedad, aeroparque

SOCIEDAD

Cómo los gigantes de la IA intentaron tomar al asalto el último reducto de la mente humana: las olimpiadas matemáticas

La noticia dio la vuelta al mundo en minutos. La inteligencia artificial (IA) había conseguido por primera vez una medalla en la prestigiosa Olimpiada Internacional de Matemática (IMO, por sus siglas en inglés), un concurso en que los 600 chavales más brillantes del mundo se enfrentan a seis problemas que han sido diseñados en secreto durante un año, y que deben resolver con solo lápiz, papel y su cerebro. Es mucho más que un concurso. Es el lugar en el que se maceran las mentes matemáticas que después solucionarán problemas imposibles y dirigirán las compañías tecnológicas que gobiernan el mundo. La noticia de la medalla que ganó la IA fue publicada por miles de medios y elegida como uno de los mayores avances científicos del año por la revista Science. Y aquí es cuando la narración comienza a complicarse. Porque la noticia es mentira.

Seguir leyendo

Ciencia,Inteligencia artificial,Tecnología,Matemáticas,OpenAI,Google,Google DeepMind,Investigación científica

SOCIEDAD

Digimon Story: Time Stranger confirma un gran DLC para 2027 – Nintenderos

Kazumasa Habu anunció hace un tiempo que ya no es la productora de juegos de Digimon en Bandai Namco debido a cambios de personal. Es interesante notar los cambios en la dirección de los juegos de Digimon en Bandai Namco ahora que tenemos detalles de la siguiente entrega. Ya se ha anunciado Digimon Story: Time Stranger para Nintendo Switch 2, y ahora tenemos detalles adicionales de esta versión.

También conocimos que si compras Digimon Story Time Stranger en la Switch original, al ponerlo en Switch 2 podrás descargar una actualización gratuita con mejoras gráficas, equivalente a la versión nativa de Switch 2. Ahora toca hablar de su DLC, ya que, tras el “Additional Digimon & Episode Pack 3: Anti-ParadoX”, parece que tenemos más en camino.

Esto es lo compartido hoy:

Nuevo DLC para Digimon Story: Time Stranger

Bandai Namco (editora) y Media.Vision (desarrolladora) han anunciado un DLC de gran escala.

Este contenido descargable llegará en el año 2027.

Resultados del Digimon Referendum #139

Encuesta oficial para elegir qué Digimon quieren ver o entrenar los fans en futuros juegos.

Los usuarios podían elegir entre 35 Digimon seleccionados.

- Top 10 Digimon más votados

Gammamon

Loogamon

Kazemon

Gumdramon

Pulsemon

Herissmon

Terriermon Assistant

Meicoomon

Ludomon

Gekkomon

Fuente.

Digimon Story: Time Stranger,dlc

SOCIEDAD

Neurocientíficos, militares y un preso: así trabaja el grupo que “hackea” la IA de Microsoft antes de que llegue al público

MADRID.- Brad Smith, presidente de Microsoft, se toma un segundo para reflexionar y usa la palabra “guardarraíles” con la naturalidad de quien pensó mucho en los precipicios. Se celebran unas jornadas sobre la innovación de la compañía en su sede de Redmond (EE.UU.), al que han sido invitados este y otros diarios internacionales, y EL PAÍS le pregunta cómo y quién determina si la inteligencia artificial (IA) de la empresa puede ser utilizada en un contexto de guerra, como el actual. Hace tan solo unos días que se hizo público que la firma de IA Anthropic ha demandado al Pentágono por vetarla tras marcar líneas rojas en el uso de su tecnología.

Es el debate del momento en el mundo de las grandes tecnológicas, y es un asunto muy familiar para Microsoft: en 2021, el Pentágono canceló un acuerdo de US$10.000 millones con la firma tras las protestas de sus empleados. Microsoft, de hecho, apoya a Anthropic en su pelea con el Pentágono.

Smith responde: “Tenemos principios, los definimos y los publicamos. Por definición, esos principios crean guardarraíles. Y nos mantenemos en la carretera dentro de ellos. No se trata solo de cuándo debemos usar la tecnología, sino también de cuándo no debemos usarla”.

Microsoft tiene para ello un equipo que hackea sus propios productos: el “equipo rojo” o red team. El nombre tiene historia militar. Los red teams surgieron en los ejércitos para simular ataques enemigos y detectar vulnerabilidades propias antes de que lo hiciera el adversario real. En ciberseguridad, la práctica lleva décadas establecida. Pero aplicarla a la IA generativa es algo relativamente nuevo, y Microsoft se atribuye haber sido pionera, al formar este equipo en 2018.

“Antes de que se lance un producto, los equipos rojos ‘rompen’ la tecnología para que otros puedan reconstruirla más sólida y segura”, explica Ram Shankar Siva Kumar, “cowboy de datos”, según se autodenomina, y líder del equipo rojo. “La IA puede provocar problemas, desde fallas de seguridad hasta daños psicosociales. La gente usa Copilot [la IA de Microsoft] en momentos de gran vulnerabilidad, así que observar cómo pueden fallar estos sistemas antes de que lleguen al usuario es una cuestión fundamental”, explica.

Esta especie de “asuntos internos» de la IA analizó ya más de 100 productos de la compañía. Microsoft no ofrece datos de cuántas personas trabajan en él, ni sobre si se han parado productos ni cuáles. Pero sí asegura que el equipo tiene el poder para hacerlo: “Ningún sistema de IA de alto riesgo se implementa sin antes someterse a una prueba independiente. Si nuestro equipo identifica riesgos graves que no se han mitigado, el producto no se lanza hasta que se resuelvan esos problemas”, asegura Kumar.

La pregunta que se hace el equipo a la hora de analizar un producto antes de que sea lanzado es: “¿Cómo podría usarse este sistema de IA, para bien o para mal, dentro de meses o años?”.

Seis principios

Los “guardarraíles” que mencionaba Smith son seis principios genéricos que el equipo, sin embargo, cree que son muy claros a la hora de examinar los productos: equidad, responsabilidad, transparencia, confiabilidad y seguridad, inclusión y privacidad y seguridad. Estos principios se transforman, en el día a día, en herramientas concretas. “Si le das a un ingeniero un documento de 50 páginas para que implemente esos principios, se va a abrumar. Tenemos una herramienta de código abierto llamada Pyrit; la construimos para nosotros y luego la pusimos a disposición del mundo, porque creemos en la salud del ecosistema”, dice Kumar.

En el equipo rojo hay neurocientíficos, lingüistas, especialistas en seguridad nacional, expertos en ciberseguridad, veteranos militares e incluso una persona que estuvo en prisión “y se rehabilitó”, explica Kumar. Además, se hablan 17 idiomas , y “algunos dialectos del francés, mongol, tailandés, coreano”, según el jefe del equipo, ya que una de las obsesiones del red team, explica, es que la IA no cometa errores en ningún lugar del mundo.

Junto a Kumar dirige las operaciones del equipo rojo Tori Westerhoff, cuyo perfil combina neurociencia cognitiva —estudió en Yale y fue de las primeras miembros de la Iniciativa de Neurociencia de Wharton— y estrategia de seguridad nacional, ya que trabajó en agencias de inteligencia y defensa. “Cuando recibimos un encargo emulamos lo que podría salir mal en los extremos de la curva de uso de esa tecnología. Mi equipo profundiza en cómo utilizar ese producto tal como está previsto, y de maneras no previstas, para obtener los casos más extremos y ayudar al equipo de producto a reproducirlos y mitigarlos antes de que puedan ser utilizados por alguien en el mundo real”, añade.

Un ejemplo de su trabajo fue el red teaming, como denominan internamente a su hackeos, de GPT-5, el modelo de OpenIA (socio de Microsoft) lanzado el pasado agosto. Lo que hicieron fue entrenar a otra IA para que intentara hackear al programa, de forma automática y a una escala imposible para humanos.

Cuando probaron GPT-5, el equipo rojo utilizó Pyrit para generar más de dos millones de conversaciones-trampa de forma automática. La IA atacante intentaba engañar a la IA atacada, sin parar, durante días, explorando combinaciones que a un humano jamás se le ocurrirían. Encontrar esos puntos débiles manualmente es un proceso lentísimo; por eso, entrenaron a esa IA para que intentara romper otra IA, “como en Inception”, dice Kumar, en referencia a la película de Christopher Nolan donde los personajes entran en sueños dentro de sueños.

Sin embargo, Westerhoff, Kumar y Daniel Krutz, que dirige la oficina de IA Responsable de la compañía, insisten en una idea: la automatización tiene un límite. “El red teaming solo puede automatizarse hasta cierto punto, y solo los humanos pueden determinar si una respuesta generada por IA les resulta incómoda o representa un sesgo”, asegura la compañía. El criterio lo pone la persona; la escala, la máquina. Esa división del trabajo define la filosofía del equipo.

Westerhoff cree que, de hecho, solo la mente humana es capaz de “imaginar esos espacios que aún no se han observado, que no se han definido completamente ni explorado; nuestro trabajo consiste en innovar y crear más allá del espacio que se ha sistematizado”.

El equipo identifica tres áreas donde la automatización es ciega por definición y el juicio humano resulta imprescindible. La primera tiene que ver con las materias; se necesitan personas para evaluar el riesgo en áreas como medicina o seguridad. La segunda tiene que ver con los lugares donde se lanza esa IA. “Necesitamos humanos para tener en cuenta las diferencias lingüísticas y redefinir qué constituye un daño en distintos contextos políticos y culturales”, dice la empresa. Y la tercera, la inteligencia emocional. En última instancia, solo los humanos pueden evaluar el rango de interacciones que los usuarios podrían tener con los sistemas de IA. Un modelo puede pasar todas las pruebas automatizadas y aun así producir respuestas que resulten perturbadoras para una persona real en una situación concreta.

Este modo de ver la IA coincide con la visión de Mustafa Suleyman, uno de los fundadores de Deepmind (ahora parte de Google) y CEO de Microsoft AI. Hace unos días, escribía en la revista Nature: “Una IA aparentemente consciente se puede convertir en un arma”. A medida que los sistemas de inteligencia artificial imitan cada vez más la estructura del lenguaje humano, argumenta, necesitamos normas de diseño y leyes que impidan que sean confundidos con seres sintientes. “Deben seguir siendo fundamentalmente responsables ante los humanos y estar supeditados al bienestar de la humanidad”, escribe Suleyman. “Los agentes de IA no deberían tener más derechos ni libertades que mi portátil”.

La filosofía central que articula el trabajo del equipo rojo es, en fin, que “la IA responsable no es un filtro que se aplica al final del desarrollo, sino una parte fundacional del proceso”, dice Kumar. Son los guardarraíles de Smith, que no actúan en realidad como frenos, sino como condición para ir rápido sin despeñarse.

POLITICA3 días ago

POLITICA3 días agoKicillof desembarcó en CABA, lanzó su proyecto 2027 y empezará a ampliar su armado político en todo el país

POLITICA2 días ago

POLITICA2 días ago¿MACRI 2027? El «operativo retorno» que sacude al PRO y los nombres que suenan para la vicepresidencia

POLITICA2 días ago

POLITICA2 días ago¿FIN DE CICLO? Escándalo por la mansión no declarada y viajes de lujo empujan a Manuel Adorni fuera del Gobierno: Su salida sería inminente